Index

Entwicklung und Evaluation einer integrierten Softwarepipeline für die freihändige multimodale Ultraschalldatenerfassung

Die freihändige 3D-Rekonstruktion von Ultraschall- und Elastographiedaten erfordert eine zuverlässige Erfassung, Synchronisation und Verarbeitung mehrerer Datenströme. In einem Forschungsprojekt wurde hierfür eine Python-basierte Scan-Pipeline aufgebaut, die jedoch aktuell aus mehreren separaten Skripten besteht und stark von manuellem Bedienwissen abhängt. Dies erschwert die reproduzierbare Durchführung von Messungen und die Weiterentwicklung des Systems.

Ziel dieser Arbeit ist es, die bestehende Pipeline in eine konsistente und bedienbare Softwarelösung zu überführen. Dazu sollen bestehende Komponenten analysiert, geeignete Softwarestrukturen entwickelt und die einzelnen Verarbeitungsschritte in einem robusten Workflow zusammengeführt werden. Die resultierende Lösung soll die Nutzung des Systems vereinfachen und gleichzeitig die Grundlage für standardisierte experimentelle Untersuchungen schaffen.

Inhalte:

- Analyse und Dokumentation der bestehenden Python-basierten Scan-Pipeline

- Identifikation kritischer manueller Prozessschritte und softwaretechnischer Schwachstellen

- Entwurf einer modularen Architektur zur Integration der bestehenden Komponenten

- Implementierung einer zentralen Steuerung für Datenerfassung, Synchronisation und Vorverarbeitung

- Entwicklung von Mechanismen für Logging, Konfigurationsverwaltung und Fehlerdiagnose

- Experimentelle Evaluation der Pipeline hinsichtlich Stabilität, Bedienbarkeit und Reproduzierbarkeit

Voraussetzungen:

- Interesse an Softwareentwicklung im Kontext medizintechnischer Forschungssysteme

- Gute Kenntnisse in Python

- Erfahrung mit modularer Softwareentwicklung, Datenverarbeitung oder Automatisierung von Vorteil

- Kenntnisse in Git, GUI-Frameworks oder experimentellen Softwaresystemen wünschenswert

- Selbstständige und strukturierte Arbeitsweise

Bewerbung: Interessierte Studierende senden ihre Bewerbung mit aktueller Notenübersicht und Lebenslauf per E-Mail.

Beginn: ab sofort

Master Thesis – Robotics & Machine Loading Automation – bei Siemens Healthineers

Standort: Kemnath

Fachabteilung: SHS TE MP KEM PCE FAS

Art der Anstellung: Befristet

Eingruppierung: Abschlussarbeit

Wollen Sie die Zukunft des Gesundheitswesens mitgestalten? Wir bei Siemens Healthineers setzen auf Menschen, die ihre Energie und Leidenschaft diesem Ziel widmen – das sagt schon unser Unternehmensname. Er steht für den Pioniergeist unserer Mitarbeiter, gepaart mit unserer langen Tradition als Technologieanbieter in der stets dynamischen Gesundheitsbranche.

Wir bieten Ihnen ein flexibles und dynamisches Umfeld voller Gelegenheiten, über die eigene Komfortzone hinaus zu wachsen, um sich persönlich und beruflich weiterzuentwickeln. Klingt das interessant für Sie?

Dann werden Sie Teil unseres globalen Teams als Master Thesis – Robotics & Machine Loading Automation

Your Tasks and Responsibilities:

- Analysis of machine loading processes such as material and tool feeding

- Definition of the ecosystem requirements for fulfilling the loading processes

- Creation of a decision matrix to determine the optimal system for the technical solution requirements (AMR + cobot/humanoid robot)

- Contacting various suppliers and developing a solution to implement a potential solution

- Creation and execution of prototype tests

Your Qualifications and Experience:

- You are looking for a Master’s project in the field of collaborative robotics.

- You are studying natural sciences, engineering, automation, or a related field.

- You have experience with collaborative robotics.

- Solid knowledge of software development principles and best practices.

- Experience with or a strong interest in AI and machine learning, ideally in the context of autonomous mobile robots (AMRs) or humanoid robotics.

Your Profile and Skills:

- You are curious, proactive, and eager to learn new skills and technologies.

- You are fluent in English and German, both written and spoken

- You work independently and follow a structured approach to problem-solving.

- You possess strong analytical skills and can break down complex tasks into manageable steps.

- You are a team player with excellent communication skills and are committed to meeting deadlines and collaborate effectively.

Unser globales Team:

Siemens Healthineers ist ein weltweit führendes Medizintechnikunternehmen. Mit mehr als 65.000 engagierten Mitarbeitern in über 70 Ländern gestalten wir die Zukunft des Gesundheitswesens. Jeden Tag profitieren etwa fünf Millionen Patienten weltweit von unseren innovativen Technologien und Dienstleistungen aus den Bereichen Diagnostik und therapeutische Bildgebung, Labordiagnostik und molekulare Medizin sowie von unseren digitalen Gesundheits- und Unternehmensdienstleistungen.

Unsere Kultur:

Unsere Unternehmenskultur schätzt verschiedene Blickwinkel, offene Diskussionen und den Willen, Konventionen in Frage zu stellen. Ständiger Wandel gehört zu unserem Arbeitsalltag. Wir wollen in unserer Branche Veränderungen vorantreiben, statt nur darauf zu reagieren. Deswegen laden wir Sie ein, sich neuen Herausforderungen zu stellen, eigene Ideen auszutesten und Erfolge zu feiern.

Besuchen Sie auch unsere Karriere-Seite unter https://www.siemens-healthineers.com/de/careers

Wir legen Wert auf Chancengleichheit und freuen uns über Bewerbungen von Menschen mit Behinderung.

Wir nehmen den Schutz Ihrer Daten und die Einhaltung der DSGVO und anderer Datenschutzgesetze ernst. Deshalb bitten wir Sie, uns Ihren Lebenslauf nicht per E-Mail zu schicken. Wir bitten Sie stattdessen, ein Profil in unserer Talent Community anzulegen. Dort können Sie Ihren Lebenslauf hochladen. An der Einrichtung eines Profils erkennen wir, dass Sie an Karrieremöglichkeiten bei uns interessiert sind und wir können Sie leicht benachrichtigen, wenn relevante Stellen frei werden. Klicken Sie hier, um ein Profil anzulegen.

Siemens Healthineers Deutschland wurde mit dem Zertifikat Great Place to Work® ausgezeichnet.

Master Thesis Student – KnowledgeSeparated AI Architecture for Product-Generalizable Test Automation in X-ray Systems – bei Siemens Healthineers

Standort: FOR AL

Fachabteilung: SHS TE PV R&D TC TIN

Art der Anstellung: Befristet

Kontakt: hua.huang@siemens-healthineers.com

Eingruppierung: Masterarbeit

Wollen Sie die Zukunft des Gesundheitswesens mitgestalten? Wir bei Siemens Healthineers setzen auf Menschen, die ihre Energie und Leidenschaft diesem Ziel widmen – das sagt schon unser Unternehmensname.

Er steht für den Pioniergeist unserer Mitarbeiter, gepaart mit unserer langen Tradition als Technologieanbieter in der stets dynamischen Gesundheitsbranche.

Wir bieten Ihnen ein flexibles und dynamisches Umfeld voller Gelegenheiten, über die eigene Komfortzone hinaus zu wachsen, um sich persönlich und beruflich weiterzuentwickeln.

Klingt das interessant für Sie?

Dann werden Sie Teil unseres globalen Teams als Master Thesis Student – KnowledgeSeparated AI Architecture for Product-Generalizable Test Automation in X-ray Systems.

Your Tasks and Responsibilities:

• Design and implement a knowledge-separated AI architecture for generating structured test cases from natural language requirements across multiple X-ray products.

• Develop a Product Knowledge Package (PKP) framework that externalizes product-specific APIs, constraints, parameter ranges, and testing rules.

• Implement a constraint-aware LLM generation pipeline using enterprise-approved APIs (no model fine-tuning).

• Design and develop a closed-loop validation and repair mechanism to automatically detect and correct structural inconsistencies, API misuse, parameter violations, missing mandatory steps, and logical order errors.

• Conduct cross-product generalization experiments and analyze failure taxonomy across different X-ray system variants.

• Evaluate system performance using quantitative metrics such as generation success rate and repair iterations.

Your Qualifications and Experience:

• Currently enrolled in a Master’s program in Computer Science, Engineering, Data Science, or a related field.

• Strong experience with Python programming (both functional and object-oriented).

• Solid understanding of software architecture, API integration, and structured data modeling.

• Experience or a strong interest in Large Language Models (LLMs), Retrieval-Augmented Generation (RAG) and AI reliability are validation mechanisms.

• Basic knowledge of automated testing concepts and tools is a plus.

• Familiarity with machine learning concepts is beneficial but model training is not required.

Your Profile and Skills:

• You are curious, proactive, and eager to learn new skills and technologies.

• You are fluent in English, both written and spoken (German is a plus, but not required).

• You work independently and follow a structured approach to problem-solving.

• You possess strong analytical skills and can break down complex tasks into manageable steps.

• You are a team player with excellent communication skills and are committed to meeting deadlines and collaborate effectively.

Unser globales Team:

Siemens Healthineers ist ein weltweit führendes Medizintechnikunternehmen. Mit mehr als 65.000 engagierten Mitarbeitern in über 70 Ländern gestalten wir die Zukunft des

Gesundheitswesens. Jeden Tag profitieren etwa fünf Millionen Patienten weltweit von unseren innovativen Technologien und Dienstleistungen aus den Bereichen Diagnostik und

therapeutische Bildgebung, Labordiagnostik und molekulare Medizin sowie von unseren digitalen Gesundheits- und Unternehmensdienstleistungen.

Unsere Kultur:

Unsere Unternehmenskultur schätzt verschiedene Blickwinkel, offene Diskussionen und den Willen, Konventionen in Frage zu stellen. Ständiger Wandel gehört zu unserem Arbeitsalltag.

Wir wollen in unserer Branche Veränderungen vorantreiben, statt nur darauf zu reagieren. Deswegen laden wir Sie ein, sich neuen Herausforderungen zu stellen, eigene Ideen

auszutesten und Erfolge zu feiern.

Besuchen Sie auch unsere Karriere-Seite unter https://www.siemens-healthineers.com/de/careers

Wir legen Wert auf Chancengleichheit und freuen uns über Bewerbungen von Menschen mit Behinderung.

Siemens Healthineers Deutschland wurde mit dem Zertifikat Great Place to Work® ausgezeichnet.

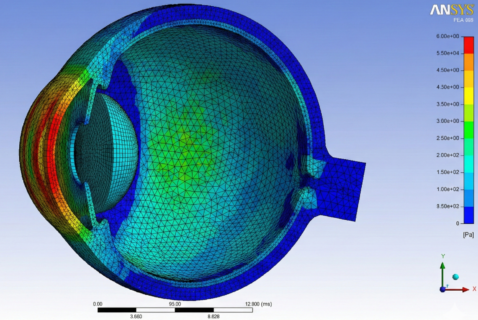

Biomechanische FEM-Simulation des menschlichen Auges unter akustischer Anregung

Thema: Entwicklung eines transienten Finite-Elemente-Modells (ANSYS) zur Analyse von Hornhautschwingungen

Bereich: Computational Biomechanics | Simulation | Maschinenbau

Software: ANSYS

Ziel: Schaffung eines “Digitalen Zwillings” zur Validierung eines neuartigen Tonometer-Verfahrens

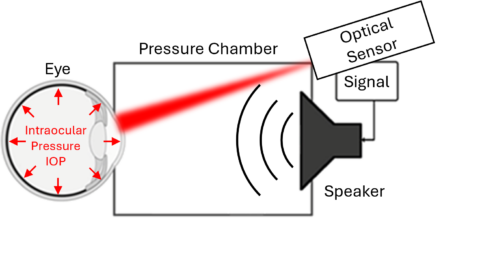

Das Forschungsprojekt

Unser innovatives Handgerät zur Messung des Augeninnendrucks (IOP) basiert auf der Analyse von Schwingungen, die berührungslos durch Schallwellen auf der Hornhaut (Cornea) induziert werden. Um die komplexen Wechselwirkungen zwischen dem akustischen Druck, den viskoelastischen Eigenschaften des Gewebes und dem Augeninnendruck vollständig zu verstehen, ist eine detaillierte numerische Simulation unerlässlich. Deine Arbeit liefert das theoretische Fundament für das Messprinzip.

Deine Herausforderungen

- Modellaufbau: Entwicklung eines parametrisierten 3D-FE-Modells des vorderen Augensegments (Cornea, Sklera, Limbus) in ANSYS basierend auf vorherigen Arbeiten.

- Materialmodellierung: Implementierung realistischer Materialgesetze für biologisches Weichgewebe. Die Herausforderung liegt in der Abbildung des nicht-linearen, anisotropen und viskoelastischen Verhaltens der Hornhaut.

- Simulation & Randbedingungen:

- Aufbringen des Augeninnendrucks (IOP) als statische Vorlast (Pre-Stressing).

- Durchführung transienter dynamischer Analysen zur Simulation der kurzen akustischen Anregung durch das Gerät.

- Sensitivitätsanalyse: Untersuchung, wie sich Änderungen der Geometrie (z. B. Hornhautdicke, Krümmung) und des IOP auf die Schwingungsantwort (Amplituden, Resonanzfrequenzen, Dämpfung) auswirken.

- (Optional/Advanced): Erste Schritte Richtung Fluid-Struktur-Interaktion (FSI) zur Berücksichtigung des Kammerwassers.

Dein Profil

- Fundierte Kenntnisse in der Finite-Elemente-Methode und praktische Erfahrung mit ANSYS.

- Starkes Interesse an Kontinuumsmechanik und der Simulation biologischer Systeme.

- Abstraktionsvermögen, um komplexe biologische Strukturen in effiziente numerische Modelle zu überführen.

Was wir bieten

- High-End Simulation: Zugang zu leistungsstarken Rechnern für deine Simulationen.

- Theorie trifft Praxis: Deine Simulationsergebnisse werden direkt mit den Messdaten unseres realen Prototyps abgeglichen.

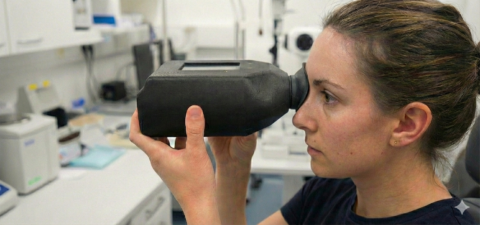

KI-basierte Qualitätsanalyse für die häusliche Glaukom-Vorsorge zur Verbesserung der Augenheilkunde

Thema: Entwicklung eines neuronalen Netzes zur Validierung kontaktloser Selbsttonometrie-Daten

Bereich: Machine Learning | Deep Learning | Medizintechnik

Ziel: Intelligente Fehlererkennung für ein zuverlässiges Anwender-Feedback

Das Forschungsprojekt

Die kontaktlose Messung des Augeninnendrucks zu Hause (Selbsttonometrie) ist ein Meilenstein in der Glaukom-Vorsorge. Damit die Messwerte jedoch klinisch verwertbar sind, müssen Anwendungsfehler – wie eine unzureichende Abdichtung der Druckkammer oder Störungen im Messablauf – sicher erkannt werden. Deine Aufgabe ist es, ein binäres Klassifikationsmodell zu entwickeln, das direkt nach der Messung entscheidet: Ist der Wert valide oder muss die Messung wiederholt werden?

Deine Schwerpunkte

- Data Preprocessing: Entwicklung von Pipelines zur Normalisierung, Bereinigung und Reduktion der Sensordaten auf die entscheidenden Merkmale.

- Modellentwicklung: Training und Optimierung von Neuronalen Netzen, um zwischen gültigen und ungültigen Messungen zu unterscheiden.

- Minimierung der Unsicherheit: Evaluation des Modells mittels Trainings-, Validierungs- und Testdatensätzen, um eine extrem geringe Vorhersageunsicherheit zu erreichen.

- Smart Feedback: Implementierung der Logik für ein direktes Nutzer-Feedback, das die Zuverlässigkeit der häuslichen Diagnose sicherstellt.

Dein Profil

- Sicherer Umgang mit Python und ML-Frameworks (z. B. PyTorch oder TensorFlow).

- Analytische Denkweise und ein grundlegendes Verständnis für die Aufbereitung von Zeitreihen-Daten.

- Interesse daran, theoretisches Wissen über neuronale Netze in ein reales Medizinprodukt zu überführen.

Warum dieses Projekt?

- Sinnstiftende KI: Deine Algorithmen helfen direkt dabei, Fehlbehandlungen zu vermeiden und die Augengesundheit von Patient:innen zu schützen.

- Professionelles Umfeld: Wir bieten dir eine strukturierte Betreuung und die notwendige Rechenpower für dein Modelltraining.

- Innovation: Du arbeitest an der Schnittstelle von modernster Sensorik und Deep Learning.

Hinweise zur Bewerbung

- Beginn: Ab sofort oder nach Vereinbarung jederzeit möglich.

- Bewerbungsunterlagen: Bitte sende deine Bewerbung mit einem aktuellen Lebenslauf und deiner Notenübersicht per E-Mail an: helmut.engelhardt@faps.fau.de.

- Kontakt: Du hast Fragen zum Thema? Weitere Informationen geben ich dir gerne auf Anfrage per Mail oder in einem persönlichen Gespräch vor Ort.

Deep Learning zur Präzisionsmessung des Augeninnendrucks

Thema: KI-basierte Schätzung des aus Zeitreihen-Rohdaten unter Einbeziehung biometrischer Faktoren

Bereich: Deep Learning | Signalverarbeitung | Medizintechnik

Datenbasis: Exklusive klinische Studiendaten mit Goldmann-Referenzwerten

Die Forschungsfrage

Wie lässt sich der Augeninnendruck aus den akustischen Antwortsignalen unseres Prototyps präzise berechnen? In einer klinischen Studie wurden bereits Rohdaten von zahlreichen Patienten erfasst. Neben den Referenzwerten des Goldmann-Applanationstonometers (Goldstandard) liegen uns umfassende biometrische Daten vor. Deine Aufgabe ist es, ein Modell zu entwickeln, das nicht nur den Druck schätzt, sondern auch versteht, wie Faktoren wie die Hornhautdicke () oder die Augenlänge das Messergebnis beeinflussen.

Deine Herausforderungen

- Zeitreihen-Analyse: Interpretation der komplexen Rohsignale, die durch die akustische Anregung des Auges entstehen.

- Multimodale Regression: Entwicklung eines Neuronalen Netzes, das sowohl Zeitreihen als auch statische biometrische Faktoren (wie Korneadicke, Alter) als Input verarbeitet.

- Biometrische Korrektur: Untersuchung und Quantifizierung der Einflüsse (Sensitivitätsanalyse): Wie stark verfälschen unterschiedliche Hornhautstärken die Messung und wie kann die KI dies kompensieren?

- Validierung: Statistische Auswertung der Vorhersagegenauigkeit gegen den klinischen Goldstandard (Bland-Altman-Analyse).

Dein Profil

- Erfahrung in der Verarbeitung von Zeitreihen (Time-Series) und fundierte Kenntnisse in Python (PyTorch/TensorFlow).

- Interesse an medizinischer Statistik und der Korrelation physikalischer Parameter.

- Du arbeitest gerne mit “echten”, oft verrauschten Daten aus der klinischen Praxis.

Was wir bieten

- Echte klinische Relevanz: Deine Arbeit trägt direkt dazu bei, die Genauigkeit der häuslichen Glaukom-Vorsorge auf Goldstandard-Niveau zu heben.

- Hochwertiger Datensatz: Zugriff auf eine sorgfältig kuratierte Datenbank aus klinischen Studien.

Hinweise zur Bewerbung

- Beginn: Ab sofort oder nach Vereinbarung jederzeit möglich.

- Bewerbungsunterlagen: Bitte sende deine Bewerbung mit einem aktuellen Lebenslauf und deiner Notenübersicht per E-Mail an: helmut.engelhardt@faps.fau.de.

- Kontakt: Du hast Fragen zum Thema? Weitere Informationen geben ich dir gerne auf Anfrage per Mail oder in einem persönlichen Gespräch vor Ort.

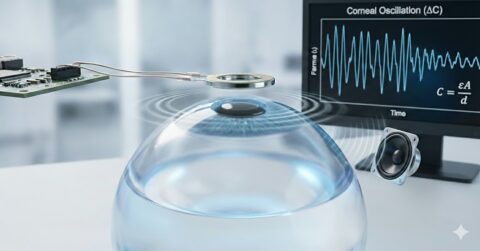

Innovation für die Augenheilkunde – Kapazitive Präzisions-Sensorik zur Detektion akustisch induzierter Corneaschwingungen

Bereich: Medizintechnik / Elektrotechnik

Impact: Verbesserung der Glaukom-Früherkennung zur Vermeidung von Erblindung

Warum dieses Thema wichtig ist

Der Augeninnendruck ist einer der wichtigsten Indikatoren für Glaukom (Grüne Star). In diesem Projekt entwickeln wir eine neuartige, berührungslose Sensorik, die feine Schwingungen der Cornea nutzt, um diagnostische Präzision auf ein neues Level zu heben. Du arbeitest hier an einer Technologie, die später direkt Patient:innen zugutekommen kann.

Die Herausforderung

Wie misst man die Schwingung einer biologischen Oberfläche, ohne sie zu berühren? Im Rahmen dieses Projekts nutzen wir Schallwellen zur Anregung der Cornea. Deine Aufgabe ist die kapazitive Erfassung dieser Cornea-Schwingung. Da sich die Distanz zwischen Sensor und Auge im Mikrometerbereich ändert, entstehen extrem kleine Kapazitätsänderungen, die präzise vom Hintergrundrauschen getrennt werden müssen.

Dein Beitrag zur Forschung

- Konzeption des Sensorkopfes: Du entwirfst eine Elektrodengeometrie, die optimal auf die Krümmung der Cornea abgestimmt ist.

- Relative Distanzmessung: Du implementierst ein Verfahren zur Erfassung der Schwingungsamplitude .

- Signal-Rausch-Optimierung: Da biologische Gewebe komplexe dielektrische Eigenschaften haben, optimierst du die Messschaltung (z. B. mittels Lock-in-Verstärkung), um die induzierte Schwingung sauber zu isolieren.

- Validierung am Modell: Du testest dein System an Augen-Phantom oder porzinen Augen, deren Augeninnendruck einstellbar ist.

Was du mitbringst

- Freude an der Verbindung von theoretischer Modellierung und praktischer Laborarbeit.

- Eine strukturierte Arbeitsweise und die Fähigkeit, dich in komplexe, fachübergreifende Fragestellungen einzudenken.

- Kenntnisse in Tools wie MATLAB oder Python sind willkommen, aber kein Ausschlusskriterium.

Hinweise zur Bewerbung

- Beginn: Ab sofort oder nach Vereinbarung jederzeit möglich.

- Bewerbungsunterlagen: Bitte sende deine Bewerbung mit einem aktuellen Lebenslauf und deiner Notenübersicht per E-Mail an: helmut.engelhardt@faps.fau.de.

- Kontakt: Du hast Fragen zum Thema? Weitere Informationen geben ich dir gerne auf Anfrage per Mail oder in einem persönlichen Gespräch vor Ort.

MA Entwicklung einer KI-basierten multimodalen Steuerung für intelligente Rollstühle mittels EMG-Signalen

Motivation

Mobilitätseinschränkungen haben weitreichende Folgen für den Alltag der Betroffenen und führen neben der körperlichen Einschränkung häufig auch zu psychischen Belastungen. Der Rollstuhl stellt oft die einzige Möglichkeit dar, am täglichen Leben teilzunehmen. Klassische Steuerungskonzepte stoßen jedoch bei komplexen Krankheitsbildern (z.B. hohen Querschnittlähmungen) an ihre Grenzen, da die verbleibenden Muskelaktivitäten oft nicht ausreichen, um einen Joystick präzise zu führen.

Das Projekt EMGRoll adressiert dieses Problem durch ein Sensor-Kit, das Elektromyographie (EMG) zur Steuerung nutzt. Während klassische Ansätze oft auf starren Regeln basieren, bietet die moderne Robotik mit Methoden des Reinforcement Learning (RL) und Imitation Learning neue Möglichkeiten. Ziel ist es, nicht mehr manuell Regeln für jede Situation zu programmieren, sondern ein multimodales KI-Modell zu trainieren. Dieses soll in der Lage sein, die verrauschten und hoch-individuellen EMG-Signale des Nutzers direkt mit den Umgebungsdaten (z.B. Lidar/Kamera) zu fusionieren. So entsteht eine adaptive “Shared Autonomy”, die die Intention des Nutzers versteht und intelligent in sichere Fahrbefehle umsetzt.

Zielstellung

Ziel dieser Arbeit ist die Konzeption, Implementierung und Evaluation eines Deep-Learning-basierten Navigationsansatzes, der EMG-Signale und Sensordaten in einem gemeinsamen neuronalen Netz verarbeitet.

Die Arbeit beinhaltet folgende Schwerpunkte:

- Recherche: Evaluation des aktuellen Stands der Technik im Bereich Deep Reinforcement Learning (DRL) und Learning from Demonstration (LfD) für assistive Robotik.

- Konzeption: Entwurf einer multimodalen Netzwerkarchitektur, die physiologische Signale (EMG) und exterozeptive Sensordaten (Lidar/Kamera) als Input verarbeitet.

- Implementierung: Entwicklung der Trainingsumgebung (z.B. in Simulationen wie Gazebo, Unity oder Isaac Sim) und Umsetzung des Agenten in ROS2.

- Training & Evaluation: Training des Modells mittels RL oder Imitation Learning und Validierung der Performance im Vergleich zu klassischen Ansätzen.

- Transfer: (Optional/Je nach Umfang) Sim-to-Real Transfer auf den realen Rollstuhl-Demonstrator am FAPS.

Weitere Infos auf Anfrage. Bewerbungen bitte per E-Mail mit aktueller Notenübersicht und Lebenslauf.

References

- Reinforcement Learning Based User-Specific Shared Control Navigation in Crowds

- Learning from demonstration for locally assistive mobility aids

- Learning Shared Control by Demonstration for Personalized Wheelchair Assistance

- Shared control of a brain-actuated intelligent wheelchair

- Shared control methodology based on head positioning and vector fields for people with quadriplegia

PA/MA Foundation Models für die soziale Navigation eines intelligenten Rollstuhls

Motivation

Die autonome Navigation mobiler Roboter in menschlichen Umgebungen stellt eine große Herausforderung dar. Klassische Navigationsalgorithmen (wie DWA oder A*) behandeln Menschen oft nur als dynamische Hindernisse, was zu „unhöflichem“ oder für den Nutzer unangenehmem Fahrverhalten führt. Ein intelligenter Rollstuhl muss jedoch mehr können, als nur kollisionsfrei von A nach B zu fahren: Er muss soziale Normen verstehen und sich kontextabhängig verhalten (z. B. nicht durch eine Gruppe von Menschen hindurchfahren, Vorfahrt gewähren oder auf dem Gehweg die richtige Seite wählen).

Neueste Ansätze zeigen, dass Large Foundation Models und Vision-Language Models (VLMs) über ein tiefes Verständnis menschlicher Verhaltensweisen verfügen. Diese Modelle können visuelle Szenen interpretieren und „Zero-Shot“-Entscheidungen für eine sozial konforme Navigation treffen, ohne dass dafür aufwendiges Training notwendig ist. Am FAPS wird ein intelligenter Rollstuhl entwickelt, der nun mit diesen Fähigkeiten ausgestattet werden soll. Ziel ist es, Foundation Models zu nutzen, um die Umgebung semantisch zu erfassen und Navigationspfade zu generieren oder zu bewerten, die sozial akzeptabel und für den Patienten komfortabel sind.

Inspiration liefern unter anderem folgende aktuelle Veröffentlichungen:

– VLM-Social-Nav: Socially Aware Robot Navigation Through Scoring Using Vision-Language Models

– CoNVOI: Context-aware Navigation using Vision Language Models in Outdoor and Indoor Environments

– Navigation World Models

Zielsetzung

In dieser Arbeit soll ein Ansatz entwickelt werden, der ein Foundation Model (VLM) in den Navigations-Stack des intelligenten Rollstuhls integriert. Das System soll Kamerabilder auswerten, um soziale Kontexte zu erkennen. Darauf basierend soll der Rollstuhl seine Trajektorie anpassen – entweder durch die Generierung von Wegpunkten oder durch das „Scoring“ (Bewerten) von Pfaden hinsichtlich ihrer sozialen Konformität.

Arbeitsschritte

- Einarbeitung in die bestehende ROS-Navigation des intelligenten Rollstuhls sowie in den Stand der Technik zu Social Navigation und Foundation Models

- .Auswahl und Integration eines geeigneten Modells (z. B. GPT-4o, Gemini, LLaVA oder spezialisierte Modelle wie CoNVOI/NWM)

- Entwicklung eines Moduls zur semantischen Szenenanalyse: Erkennung von sozialen Situationen und Ableitung von Verhaltensregeln

- Implementierung einer Schnittstelle zur Bewegungsplanung: Das VLM soll als „High-Level Planner“ oder „Scorer“ fungieren, um den lokalen Planer (z. B. DWA/MPC) zu beeinflussen

- Evaluation des Systems in Simulation oder Realumgebung: Vergleich des Fahrverhaltens mit klassischen Methoden hinsichtlich Komfort, Sicherheit und Einhaltung sozialer Normen

Bewerbung bitte per E-Mail mit kurzer Notenübersicht und Lebenslauf.

Fertigung und Erprobung eines Phantoms der menschlichen Lunge

Um medizintechnische Systeme für die Behandlung von Lungenerkrankungen sicher zu entwickeln und zu testen, werden Lungenphantome benötigt, die das Verhalten des menschlichen Organs im Labor nachbilden. Gerade für die Neonatologie, in der die Lunge besonders empfindlich auf Druckveränderungen reagiert, ist ein solches Phantom unverzichtbar. Die Funktionsweise und Belastbarkeit medizinischer Apparate zur mechanischen Beatmung und automatisierten Sekretentfernung – wie sie im Projekt SMART-NEO erforscht werden – kann zunächst nur an Phantomen untersucht und optimiert werden, bevor sie am Patienten eingesetzt werden dürfen. Solche Phantome ermöglichen es, mechanische Belastungen realistisch zu simulieren und die Wirksamkeit wie auch die Sicherheit neuer Verfahren unter kontrollierten Laborbedingungen zu überprüfen.

Die Fertigung eines realistischen Lungenphantoms stellt fachübergreifend eine Herausforderung dar. Die Herstellung erfordert eine gezielte Auswahl von Materialien und Fertigungsprozessen, die die elastischen und mechanischen Eigenschaften von Lungengewebe möglichst genau abbilden. Zudem müssen die Einzelkomponenten, wie Lappen oder Bronchialsegmente, in ihrer geometrischen und strukturellen Zusammensetzung mit der Dynamik biologischer Organe vergleichbar sein. Die hohe Varianz der Gewebeeigenschaften und die Notwendigkeit, physiologische Bewegungen wie Ausdehnung und Zusammenziehen im Beatmungsprozess zu reproduzieren, machen die Entwicklung eines Phantoms besonders anspruchsvoll.

Im Rahmen dieser Arbeit wird ein Phantom der menschlichen Lunge unter Nutzung additiver Fertigungsverfahren aufgebaut und erprobt. Die einzelnen Segmente der Lunge werden konstruiert und gefügt, um das mechanische Verhalten bei Unterdruck und Beatmung experimentell zu untersuchen. Mithilfe von zu definierenden Materialparametern und Geometrien sollen gezielt Druck- und Volumenverläufe simuliert und deren Einfluss auf die mechanische Belastung analysiert werden. Optional wird das Testsystem mit Sensorik zur Messung von Druck- und Volumenänderungen ausgestattet, um die Analyse der Strukturreaktionen zu unterstützen. Die angestrebten Ergebnisse bilden eine experimentelle Grundlage für die Bewertung und Weiterentwicklung automatisierter Absaugsysteme.

Aufgaben

- Konstruktion und Aufbau eines Lungenphantoms:

Entwurf und Fertigung der Lungenlappen und Atemwegsstrukturen mithilfe additiver Fertigungsverfahren oder geeigneter weicher Materialien. - Experimentelle Untersuchung des Verhaltens unter Druckbelastung:

Test des Phantoms bei Unterdruck und Beatmung, um Ausdehnung, Verformung und mechanische Belastungen realistisch zu erfassen. - Analyse der Material- und Strukturparameter:

Variation von Materialeigenschaften und Geometrien, optional Einsatz von Sensoren zur Messung von Druck- und Volumenänderungen.

Voraussetzungen

- Grundkenntnisse in Werkstoffkunde oder mechanischem Verhalten weicher Materialien:

Verständnis für Elastizität, Dehnung und Materialreaktionen. - Interesse an experimenteller Laborarbeit:

Bereitschaft, praktisch zu arbeiten, Messaufbauten zu nutzen und Prototypen zu testen. - Neugier für medizinische Technik und Neonatologie:

Motivation, die besonderen Anforderungen empfindlicher Lungenstrukturen und klinischer Anwendungen zu verstehen.

Hinweise und Bewerbung

Die Bearbeitung ist ab sofort möglich.

Bitte senden Sie Ihre Unterlagen (CV, Notenbescheinigung) per E-Mail an die untenstehenden Kontaktpersonen.