Index

Siemens AG [Extern BA/MA]: Entwicklung industrieller Produktionsanwendungen auf Basis des humanoiden Roboters AgiBot G2

Ausgangssituation:

Humanoide Roboter entwickeln sich derzeit rasant von reinen Forschungsplattformen hin zu industriell verwertbaren Systemen und versprechen durch ihre menschenähnliche Oberkörperkinematik eine flexible Integration in bestehende, auf den Menschen ausgelegte Produktionsumgebungen. Der AgiBot G2 ist ein wheel based humanoider Roboter mit einer radbasierten mobilen Plattform und einem humanoiden Oberkörper mit zwei Armen sowie geschickten Greifern, der speziell für industrielle Manipulations- und Logistikaufgaben konzipiert wurde. Durch den Verzicht auf eine zweibeinige Fortbewegung bietet die Plattform eine besonders hohe Stabilität, Energieeffizienz und Nutzlast bei gleichzeitig hoher Beweglichkeit in geplanten Fabrikumgebungen.

In einer Industrieumgebung der Siemens AG wird mit dem AgiBot G2 erstmals ein humanoides System dieser Klasse aufgebaut und in Betrieb genommen. Vor diesem Hintergrund besteht ein konkreter Bedarf, die Plattform systematisch zu erschließen, geeignete Schnittstellen und Toolchains zu etablieren sowie erste industrierelevante Anwendungsfälle aus dem Umfeld der Siemens AG prototypisch umzusetzen, um den Reifegrad und das Einsatzpotenzial des Systems belastbar einschätzen zu können.

Zielsetzung:

Ziel dieser Arbeit ist die erstmalige Umsetzung industrieller Anwendungsfälle auf Basis des humanoiden Roboters AgiBot G2. Im Rahmen der Arbeit sollen die Plattform aufgebaut, die relevanten Schnittstellen erschlossen sowie eine durchgängige Toolchain für Wahrnehmung, Manipulation und Navigation etabliert werden. Aufbauend darauf werden ausgewählte produktionsnahe Anwendungsfälle prototypisch umgesetzt und hinsichtlich Robustheit, Geschwindigkeit und Integrationsaufwand bewertet. Aus den Ergebnissen sollen abschließend konkrete Handlungsempfehlungen für den weiteren produktiven Einsatz des Systems im industriellen Umfeld der Siemens AG abgeleitet werden.

Aufgabenschwerpunkte & Arbeitspakete:

- Einarbeitung in den Stand der Technik zu wheeled humanoiden Robotern, bimanueller Manipulation und Foundation Models für robotische Anwendungen

- Aufbau und mechanische sowie elektrische Erstinbetriebnahme der AgiBot G2 Plattform am Standort der Siemens AG [Erlangen]

- Einarbeitung in das SDK des AgiBot G2 sowie Aufbau einer durchgängigen Toolchain für Steuerung, Wahrnehmung und mobile Manipulation

- Integration des Systems in die bestehende ROS basierte Infrastruktur des Lehrstuhls und Anbindung an relevante Sensorik und Peripherie

- Auswahl und Spezifikation industrierelevanter Anwendungsfälle in Abstimmung mit der Siemens AG

- Prototypische Umsetzung erster produktionsnaher Demonstratoren auf Basis des AgiBot G2

- Systematische Bewertung der erzielten Performanz hinsichtlich Robustheit, Geschwindigkeit, Sicherheit und Integrationsaufwand anhand definierter Kriterien

- Ableitung konkreter Handlungsempfehlungen für den weiteren produktiven Einsatz humanoider Roboter im industriellen Umfeld

- Strukturierte Dokumentation der Arbeit und Präsentation der Ergebnisse

Vorkenntnisse:

- Interesse an industrieller Robotik, humanoiden Systemen und künstlicher Intelligenz

- Erfahrung mit Linux und ROS von Vorteil

- Grundlegende Programmierkenntnisse in Python und C++ von Vorteil, aber nicht zwingend erforderlich

- Sehr gute Deutsch und Englisch Kenntnisse

Der Arbeitsumfang kann entsprechend der Art der Abschlussarbeit angepasst werden.

Bewerbungen ausschließlich per E-Mail mit aussagekräftigen Unterlagen (Lebenslauf, vollständige Notenübersicht)

Entwicklung lernbasierter Steuerungsansätze für tensegrity-inspirierte Kinematiken

Motivation

Tensegrity-inspirierte Kinematiken stellen einen vielversprechenden Ansatz für die Entwicklung innovativer robotischer Systeme dar. Aufgrund ihrer zugbasierten, flexiblen Struktur bieten sie Potenziale für leichte, anpassungsfähige und robuste mechanische Systeme. Insbesondere in Anwendungsfeldern, in denen Nachgiebigkeit, sichere Interaktion und effiziente Bewegungsabläufe von Bedeutung sind, gewinnen solche Kinematiken zunehmend an Relevanz.

Die Steuerung dieser Systeme ist jedoch mit besonderen Herausforderungen verbunden, da ihr Verhalten häufig nichtlinear, gekoppelt und nur eingeschränkt durch klassische modellbasierte Verfahren beschreibbar ist. Selbstlernende Algorithmen bieten hier die Möglichkeit, geeignete Steuerungsstrategien datenbasiert zu entwickeln und an komplexe Systemdynamiken anzupassen.

Ziel

Ziel der Abschlussarbeit ist die Untersuchung tensegrity-inspirierter Kinematiken im Hinblick auf ihre modellgestützte Beschreibung, simulationsbasierte Analyse und Steuerung mithilfe selbstlernender Algorithmen. Im Mittelpunkt steht die Frage, wie sich geeignete Lernverfahren zur Ansteuerung solcher Systeme einsetzen und bewerten lassen.

Schwerpunkte

- Einarbeitung in die Grundlagen tensegrity-inspirierter Kinematiken

- Modellierung und Simulation geeigneter Systeme

- Untersuchung selbstlernender Verfahren zur Steuerung

- Implementierung und Evaluation lernbasierter Algorithmen

- Analyse von Stabilität, Robustheit und Anpassungsfähigkeit des Systemverhaltens

Weitere Informationen

Infos auf Anfrage. Bewerbung per E-Mail mit Lebenslauf und Notenübersicht.

MA/PA: Simulation of Microexpressions for Human-Robot Interaction

We are looking for curious and motivated master’s students to join an innovative research project on the simulation of microexpressions in virtual human faces for humanoid robotics and human-robot interaction. This thesis combines social robotics, facial expression modeling, computer animation, and user-centered evaluation, contributing to the development of more expressive and socially intelligent virtual agents.

Project Overview:

This master’s thesis focuses on the simulation and evaluation of human microexpressions in virtual faces and computer-based environments. Microexpressions are subtle and short facial movements that play an important role in social communication. The aim of this thesis is to investigate how such expressions can be modeled, implemented, and perceived in virtual humans or simulated humanoid agents.

Possible research directions include:

- Study of the physiological and expressive basis of human microexpressions

- Investigation of methods for modeling subtle facial expressions in virtual agents

- Simulation of microexpressions using animation and facial modeling tools such as Blender, Unity, Unreal Engine / MetaHuman, or related frameworks

- Exploration of facial action units, blendshapes, or similar techniques for implementing subtle facial movements

- Evaluation of user preferences and perception regarding realism, naturalness, and social acceptability

The thesis will help establish a foundation for future emotionally expressive virtual humans and humanoid robots by identifying suitable design approaches and perception-related challenges.

Key Responsibilities:

- Conduct a structured review of literature on microexpressions, facial expression modeling, and human-robot interaction

- Investigate existing methods and tools for simulating subtle facial expressions in virtual environments

- Implement or prototype selected microexpression simulation approaches in a computer-based setting

- Design and analyze a user study to evaluate perceived realism, preference, and social impact

Who We’re Looking For:

- Strong interest in social robotics, virtual humans, humanoid robots, human expression, or human-robot interaction

- Background in robotics, biomedical engineering, computer science, HRI, computer graphics, animation, or a related field

- Interest in simulation, experimental design, and user-centered evaluation

- Independent, structured, and critical way of working

- Fluency in English

How to Apply:

If you are excited about expressive virtual humans and would like to contribute to research on artificial facial behavior, we invite you to apply exclusively via email, including your CV and complete transcript of records (GPA min. 2.5).

Subject: S2.1_Virtual Microexpressions

BA/PA/MA: Simulation sehnengetriebener Robotersysteme in Isaac Sim

Motivation

Sehnengetriebene Aktuationssysteme sind ein zentraler Ansatz moderner Robotik, insbesondere für humanoide und leichte, energieeffiziente Systeme. Durch die Entkopplung von Aktuator und bewegter Struktur lassen sich Massen reduzieren und komplexe Bewegungen realisieren. Für Entwicklung, Auslegung und spätere Steuerung solcher Systeme sind realitätsnahe Simulationen essenziell.

Unterschiedliche physikalische Modellierungsansätze für Seil- und Sehnenstrukturen (z. B. vereinfachte oder kontinuierliche Modelle) unterscheiden sich jedoch stark hinsichtlich Genauigkeit, Stabilität und Rechenaufwand. Diese Unterschiede wirken sich direkt auf die Nutzbarkeit in simulationsbasierten Entwicklungsprozessen und insbesondere auf Reinforcement-Learning-Anwendungen in NVIDIA Isaac Sim / Isaac Lab aus.

Ziel der Arbeit

Ziel der Arbeit ist die systematische Untersuchung und prototypische Implementierung ausgewählter Simulationsmethoden für Seil- und Sehnenstrukturen. Im Fokus steht die Frage, wie unterschiedliche physikalische Modellierungen praktisch umgesetzt werden können und welchen Einfluss sie auf das Verhalten der Simulation sowie auf die Trainingsstabilität und Performance von RL-Algorithmen haben.

Die Ergebnisse sollen vergleichbar aufbereitet und hinsichtlich ihrer Eignung für robotische Anwendungen bewertet werden.

Schwerpunkte

- Simulationsmethoden & Implementierung in Isaac Sim / Isaac Lab

- Vergleich & RL-basierte Bewertung

Weitere Informationen

Infos auf Anfrage. Bewerbung per E-Mail mit Lebenslauf und Notenübersicht.

BA/PA/MA: Entwicklung einer Dataset-Pipeline zur Erstellung multimodaler Trainingsdatensätze für KI-basierte Computer Vision Anwendungen

Ausgangssituation:

Autonome Systeme gewinnen in komplexen Einsatzbereichen wie der Baurobotik und Landwirtschaft zunehmend an Bedeutung. In diesen Einsatzbereichen müssen solche Systeme in der Lage sein, ihre Umgebung zuverlässig wahrzunehmen, um sicher und intelligent mit ihr zu interagieren. Hierfür kommen KI-basierte Computer-Vision-Systeme zum Einsatz, die Sensordaten aus multimodalen Quellen durch komplexe Transformer-Architekturen auswerten.

Insbesondere die Kombination von Kamera, Radar und LiDAR ermöglicht eine robuste Umgebungswahrnehmung auch unter schwierigen Umweltbedingungen wie Staub, Regen oder schlechten Lichtverhältnissen. Für die Entwicklung dieser komplexen KI Modelle sind große und hochqualitative Trainingsdatensätze erforderlich.

In diesen multimodalen Anwendungen fehlen jedoch effiziente Prozesse zur systematischen Aufnahme, Synchronisation und Aufbereitung der Sensordaten. Ziel dieser Arbeit ist daher die Entwicklung einer Dataset Pipeline, mit der ein strukturierter Datensatz mit etwa 10.000 multimodalen Trainingsbeispielen mit geringem menschlichen Aufwand erzeugt werden kann.

-

Einarbeitung in den Stand der Technik des Datenmanagements und der automatisierten Datenannotation

-

Analyse der vorhandenen Sensorik und Datenquellen im Versuchssystem

-

Konzeption einer Pipeline zur Aufnahme und Synchronisation von Sensordaten aus Kamera, Radar und LiDAR

-

Implementierung einer Pipeline zur automatisierten Datenerfassung und dateneffizienten Speicherung der Daten

-

Entwicklung eines (teilautomatisieren) Workflows zur Annotation der Trainingsdaten

- Exemplarische Erstellung eines multimodalen Datensatzes mit etwa 10.000 Trainingssamples

-

Strukturierte Dokumentation und Präsentation der Ergebnisse

Vorkenntnisse:

- Interesse an autonomen Systemen, neuronalen Netzen und künstlicher Intelligenz

- Grundlegende Programmierkenntnisse in Python und ROS2 von Vorteil, aber nicht erforderlich

- Sehr gute Deutsch- und Englisch-Kenntnisse

Der Arbeitsumfang kann entsprechend der Art der Abschlussarbeit angepasst werden.

Bewerbungen ausschließlich per E-Mail mit aussagekräftigen Unterlagen (Lebenslauf, vollständige Notenübersicht)

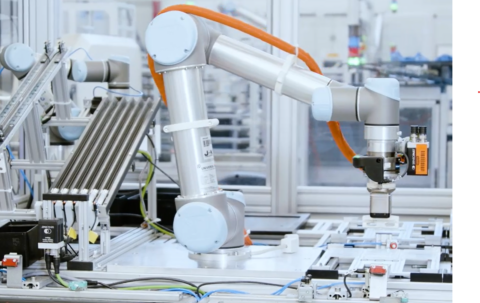

Siemens AG [BA/MA Extern]: Entwicklung einer Methodik zur effizienten Generierung von Trainingsdaten für Vision Language Action (VLA) Modell-basierte Robotermanipulation

Ausgangssituation:

Vision Language Action (VLA)-Modell- und World-Modell-basierte Ansätze versprechen einen Paradigmenwechsel beim Training von Robotersystemen für komplexe Manipulationsaufgaben mit variablen Randbedingungen. Eine wesentliche Herausforderung ist jedoch der enorme Datenbedarf, insbesondere die Generierung hochwertiger Trainingsdaten. Die oft als optimal angesehene Datenerfassung durch direkte Teleoperation des Endsystems ist extrem zeit- und kostenintensiv sowie durch menschliche Fähigkeiten limitiert. Simulationsbasierte Daten leiden wiederum oft unter mangelnder Übertragbarkeit auf reale Systeme. Es besteht ein dringender Bedarf, effizientere Wege zur Trainingsdatenerfassung für VLA-basierte Systeme im industriellen Umfeld zu finden und zu evaluieren.

Zielsetzung:

Ziel dieser Arbeit ist die Entwicklung einer Methodik zur effizienten Generierung von Trainingsdaten für VLA-basierte Robotersysteme in einem industriellen Fertigungsumfeld. Im Rahmen der Arbeit sollen verschiedene Ansätze zur Datengenerierung wie simulationsbasierte Daten, Lernen aus First-Person-View-Videos und Mischformen implementiert, analysiert und deren Einsetzbarkeit sowie Effektivität bewertet werden. Hieraus soll abschließend eine Methodik abgeleitet werden, die die effiziente Datenerzeugung für industrialisierbare VLA-basierte Ansätze ermöglicht.

- Einarbeitung in den Stand der Technik zu VLA-Modellen, Trainingsdatengenerierung und industrieller Robotik

- Strukturierte Literaturrecherche zu bestehenden Ansätzen zur Trainingsdatengenerierung sowie zu relevanten Benchmarks zur Bewertung der Effektivität verschiedener Datenerfassungsmethoden

- Umsetzung und Analyse der Einsetzbarkeit verschiedener Trainingsdatenerfassungsansätze in industriellen Prozessen

- Durchführung eines strukturierten Versuchsplans zur Erfassung von Trainingsdaten aus unterschiedlichen Quellen und anschließendes Finetuning eines VLA-Modells mit verschiedenen Datensätzen für einen exemplarischen Prozess

- Vergleich der erzielten Ergebnisse und Untersuchung des Einflusses verschiedener Datenmischstrategien auf die Modellperformanz

- Ableitung einer Methodik zur effizienten Generierung von Trainingsdaten für VLA-modellbasierte Robotermanipulation

- Strukturierte Dokumentation der Arbeit und Präsentation der Ergebnisse

Vorkenntnisse:

- Interesse an industrieller Robotik und künstlicher Intelligenz

- Grundlegende Programmierkenntnisse in Python von Vorteil, aber nicht erforderlich

- Sehr gute Deutsch- und Englisch-Kenntnisse

Der Arbeitsumfang kann entsprechend der Art der Abschlussarbeit angepasst werden.

Bewerbungen ausschließlich per E-Mail mit aussagekräftigen Unterlagen (Lebenslauf, vollständige Notenübersicht)

BA/PA/MA: Neuartiges Bein für humanoide Roboter

Humanoide Roboter werden zunehmend für vielfältige Anwendungen in Industrie, Service und Forschung eingesetzt. Zur Bewegung der Gelenke kommen derzeit überwiegend Getriebemotoren zum Einsatz. Diese stoßen jedoch bei den für humanoide Systeme typischen dynamischen Belastungen an ihre Grenzen. Insbesondere die beim Laufen auftretenden Stoßbelastungen führen dazu, dass konventionelle Gelenkgetriebe nur bedingt dauerhaft geeignet sind. In der Praxis resultiert dies in erhöhtem Verschleiß und häufigen Austauschzyklen der Getriebe, was wiederum unerwünschte Stillstandszeiten verursacht.

Am FAPS wird daher ein alternatives Bein für humanoide Roboter entwickelt, das auf Seilen basiert. Im Fokus stehen Tensegrity-Strukturen, die aufgrund ihrer nachgiebigen und lastverteilenden Eigenschaften in der Lage sind, Kraftspitzen bei Stoßbelastungen signifikant zu reduzieren und so die mechanischen Komponenten des Roboters zu schützen.

Ziel ist es, einen funktionsfähigen Beitrag zur Entwicklung eines robusteren, stoßtoleranten Beinmoduls für humanoide Roboter zu leisten und damit die Betriebssicherheit sowie die Lebensdauer der Systeme zu erhöhen.

Mögliche Aufgabenstellungen

Im Rahmen einer studentischen Arbeit können unter anderem folgende Themen bearbeitet werden:

- Aufbau und Inbetriebnahme eines Demonstrators

- Entwicklung und Integration der Aktorik

- Konzeption und Implementierung der Steuerung

- Konstruktive Weiterentwicklung des Systems, insbesondere

- Geometrieoptimierung

- Auslegung und Dimensionierung

- Festigkeits- und Strukturanalysen

Anforderungsprofil

- Engagement und Initiative bei der Umsetzung von Aufgaben

- Gute Kenntnisse in Mechanik und Maschinenbau

- Erfahrung in Konstruktion und Umgang mit CAD

- Interesse an Tensegrity-Strukturen, seilbasierten Systemen und Robotik

- Selbstständige, strukturierte und sorgfältige Arbeitsweise

- Sehr gute Deutsch- und Englischkenntnisse

Hinweise zur Bewerbung

- Beginn ist jederzeit möglich

- Bewerbungen bitte per E-Mail mit aktuellem Lebenslauf und Notenübersicht senden (unvollständige Bewerbungen werden nicht berücksichtigt)

- BA/PA/MA möglich

Siemens AG [Extern BA/MA]: KI-basierte Optimierung der Tiefenbilderfassung für Bin-Picking-Systeme in der diskreten Fertigung

Ausgangssituation:

In der diskreten Fertigung ist die Teileandienung für automatisierte Prozesse oft sehr starr und erfordert spezielle Zuführsysteme oder manuelles Vorsortieren. Dies beeinträchtigt die Wirtschaftlichkeit und Flexibilität der Produktionssysteme erheblich. Bin-Picking-Systeme, die zufällig geschüttete Bauteile durch Roboter handhaben, versprechen hier Abhilfe und sind in der Praxis bereits für viele Standardanwendungen etabliert.

Diese Systeme basieren klassischerweise auf 3D-Kamera-Eingangsdaten, deren Qualität und damit Kosten oft proportional zur Komplexität der zu greifenden Teile sind. Insbesondere bei kleinen, reflektierenden oder texturarmen Bauteilen, wie sie in der Elektronikfertigung häufig auftreten, stossen konventionelle Tiefenbildsensoren an ihre Grenzen. Neuere KI-basierte Ansätze, etwa Foundation-Stereo- und Foundation-Pose-Modelle auf Basis von NVIDIA-Technologien, versprechen eine deutliche Verbesserung der Tiefenbildqualität ohne den Einsatz hochpreisiger Spezialkameras.

Zielsetzung:

Ziel dieser Arbeit ist die Evaluierung und Verbesserung der Tiefenbilderfassung für Bin-Picking-Systeme durch den Einsatz innovativer KI-basierter Technologien. Es sollen KI-gestützte Stereovision zur Optimierung der Tiefeneingangsdaten sowie die Nutzung von 2D-Bildern aus mehreren Blickwinkeln (Multi-View-Perzeption) implementiert und untersucht werden. Die verschiedenen Ansätze sind miteinander sowie mit bestehenden Systemen zu vergleichen, um deren Potenzial für den Einsatz in der Elektronikfertigung zu ermitteln und Grenzen und Erweiterungsmöglichkeiten aufzuzeigen.

- Einarbeitung in den Stand der Technik zu KI-basierter Stereovision, Multi-View-Perzeption und Posesschätzung sowie zu bestehenden Bin-Picking-Systemen in der diskreten Fertigung

- Strukturierte Literaturrecherche zu KI-basierten Stereovision Verfahrenen sowie zu deren Einsatzpotenzial in industriellen Bildverarbeitungspipelines

- Konzeption und Durchführung eines umfangreichen Versuchsplans aus repräsentativen Testszenarien auf Basis einer marktverfügbaren Stereokamera

- Untersuchung von KI-basierten Stereovisionstechnologien zur Verbesserung der Tiefeneingangsdaten für klassische Bin-Picking-Pipelines

- Untersuchung von Multi-View-Detektoren zur weiteren Verbesserung der Datenqualität und Robustheit der Posesschätzung

- Vergleich der Ansätze untereinander sowie mit bestehenden Systemen anhand aussagekräftiger Anwendungsfälle aus der Elektronikfertigung

- Strukturierte Dokumentation der Arbeit und Präsentation der Ergebnisse

Vorkenntnisse:

- Interesse an industrieller Robotik und künstlicher Intelligenz

- Grundlegende Programmierkenntnisse in Python von Vorteil, aber nicht erforderlich

- Sehr gute Deutsch- und Englisch-Kenntnisse

Der Arbeitsumfang kann entsprechend der Art der Abschlussarbeit angepasst werden.

Bewerbungen ausschließlich per E-Mail mit aussagekräftigen Unterlagen (Lebenslauf, vollständige Notenübersicht)

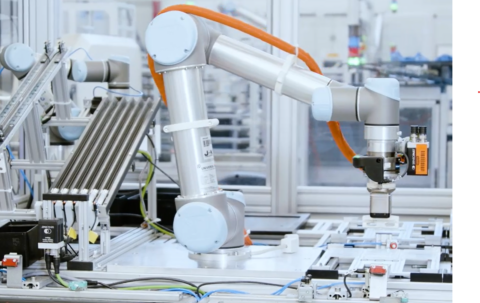

Siemens AG [Extern BA/MA]: Machbarkeitsstudie für den Einsatz von Vision Language Action (VLA) Modellen in Produktion und Logistik

Ausgangssituation:

Komplexe Manipulationsaufgaben in der industriellen Produktion zählen zu den anspruchsvollsten manuellen Tätigkeiten im Fertigungsumfeld. Die hohe Variabilität von Objekten, Gebinden und Prozessrandbedingungen macht eine vollständige Automatisierung mit klassischen regelbasierten Systemen bislang unwirtschaftlich oder technisch nicht realisierbar. Vision Language Action (VLA)-Modelle versprechen hier einen neuen Ansatz, indem sie visuelle Wahrnehmung mit generalisierter Greif- und Manipulationsfähigkeit verknüpfen.

Gleichzeitig existieren für Teilprozesse wie taktiles Fügen oder das Bin Picking bereits robuste und praxiserprobte Speziallösungen. Vor diesem Hintergrund stellt sich die Frage, in welchen Teilbereichen der industriellen Produktion durch VLA-basierte Systeme eine Steigerung des Automatisierungsgrades oder eine Reduzierung des Integrationsaufwands erreicht werden kann, beziehungsweise wie diese Automatisierungskomponenten zielführend kombiniert werden können.

Zielsetzung:

Ziel dieser Arbeit ist die Durchführung einer strukturierten Machbarkeitsstudie für den Einsatz von VLA-Modellen in Produktion und Logistik. Im Rahmen der Arbeit sollen VLA-basierte Ansätze analysiert, prototypisch implementiert und hinsichtlich ihrer Robustheit, Grenzen und Kombinierbarkeit mit klassischen Automatisierungsansätzen bewertet werden. Ziel ist die Ableitung klarer Handlungsempfehlungen, ab welchem Komplexitätsgrad und unter welchen Randbedingungen der Einsatz von VLA-Systemen gegenüber etablierten Lösungen wirtschaftlich und technisch sinnvoll ist.

- Einarbeitung in den Stand der Technik zu VLA-Modellen, klassischen Bin-Picking-Systemen und robotischer Manipulation in Produktion und Logistik

- Strukturierte Literaturrecherche und Marktanalyse zu bestehenden Automatisierungsansätzen in Produktion und Logistik sowie zu einschlägigen Bewertungsmethoden und Benchmarks

- Analyse und Klassifikation typischer Manipulationsszenarien in Produktion und Logistik nach Komplexität, Variabilität und Automatisierbarkeit

- Prototypische Implementierung und Erprobung ausgewählter VLA-basierter Ansätze sowie geeigneter Referenzsysteme für definierte Testszenarien

- Systematische Bewertung der Robustheit, Fehleranfälligkeit und Grenzen der untersuchten Systeme anhand definierter Kriterien

- Untersuchung hybrider Systemarchitekturen, bei denen VLA-Modelle und klassische Speziallösungen aufgabenabhängig kombiniert werden

- Ableitung von Empfehlungen zum effizienten Einsatzbereich von VLA-Systemen sowie zur sinnvollen Abgrenzung gegenüber herkömmlichen Automatisierungsansätzen

- Strukturierte Dokumentation der Arbeit und Präsentation der Ergebnisse

Vorkenntnisse:

- Interesse an industrieller Robotik und künstlicher Intelligenz

- Grundlegende Programmierkenntnisse in Python von Vorteil, aber nicht erforderlich

- Sehr gute Deutsch- und Englisch-Kenntnisse

Der Arbeitsumfang kann entsprechend der Art der Abschlussarbeit angepasst werden.

Bewerbungen ausschließlich per E-Mail mit aussagekräftigen Unterlagen (Lebenslauf, vollständige Notenübersicht)

BA/PA/MA: Entwicklung einer Evaluationsmethodik für die Überwachung KI-basierter Computer Vision Anwendungen

Ausgangssituation:

Mobile autonome Systeme übernehmen zunehmend sicherheitskritische Aufgaben, beispielsweise in der Landwirtschaft oder der Bauindustrie. Mit steigenden funktionalen Anforderungen an solche Systeme wachsen auch die Anforderungen an deren funktiona

le Sicherheit. Eine klare Abgrenzung sicherheitskritischer Teilbereiche wird dabei zunehmend schwieriger. Moderne Systeme setzen daher häufig auf multimodale Wahrnehmungskonzepte, bei denen Sensordaten aus verschiedenen Quellen, etwa Kamera, LiDAR und Radar, kombiniert werden, um eine robuste und zuverlässige Umfelderfassung zu ermöglichen.

Zur Auswertung dieser komplexen Datenmengen kommen überwiegend tiefe neuronale Netze zum Einsatz. Deren Entscheidungen sind jedoch häufig nur eingeschränkt nachvollziehbar. Zudem können reale Einsatzumgebungen Situationen enthalten, die während des Trainings nicht beobachtet wurden. Um die Zuverlässigkeit solcher Systeme zu erhöhen, werden daher zunehmend Methoden zur Unsicherheitsabschätzung (Out-of-Distribution Detection) sowie Ansätze der erklärbaren Künstlichen Intelligenz ( XAI) eingesetzt.

Ziel dieser Arbeit ist die Entwicklung einer Methodik zur systematischen Evaluation von Verfahren zur Unsicherheitsabschätzung sowie von Methoden der automatisierten erklärbaren KI für KI-basierte Wahrnehmungssysteme. Die entwickelte Methodik soll sowohl bestehende Ansätze aus dem Stand der Technik als auch am Institut entwickelte Verfahren methodisch evaluieren und vergleichbar machen.

-

Einarbeitung in den Stand der Technik zu künstlicher Intelligenz, erklärbarer KI und Unsicherheitsabschätzung

- Strukturierte Literaturrecherche zu automatisierten Sicherheitsframeworks

- Entwicklung einer Methodik zur systematischen Evaluation verschiedener Sicherheitsframeworks

-

Strukturierte Dokumentation und Präsentation der Ergebnisse

Vorkenntnisse:

- Interesse an autonomen Systemen, neuronalen Netzen und künstlicher Intelligenz

- Grundlegende Programmierkenntnisse in Python und ROS2 von Vorteil, aber nicht erforderlich

- Sehr gute Deutsch- und Englisch-Kenntnisse

Der Arbeitsumfang kann entsprechend der Art der Abschlussarbeit angepasst werden.

Bewerbungen ausschließlich per E-Mail mit aussagekräftigen Unterlagen (Lebenslauf, vollständige Notenübersicht)